–> Scarica qui il PDF con la guida completa! <—

Cos’è l’inferenza nell’Intelligenza Artificiale – E perché ci interessa (soprattutto quando si parla di costi)

Quando si parla di Intelligenza Artificiale, si sente spesso il termine inferenza. Ma cosa significa davvero? E perché è così centrale nel momento in cui vogliamo usare l’IA in un contesto aziendale?

Inferenza: un concetto, molti contesti

La parola “inferenza” ha radici solide in vari ambiti del sapere:

-

In logica, è il processo con cui si giunge a una conclusione partendo da premesse note.

Esempio classico:

Premessa 1: Tutti gli uomini sono mortali

Premessa 2: Socrate è un uomo

→ Inferenza: Socrate è mortale -

In statistica, si tratta della capacità di trarre conclusioni su un’intera popolazione a partire da un campione.

Esempio: Se su 1.000 persone il 60% preferisce il tè al caffè, possiamo inferire che anche nella popolazione generale la percentuale sarà simile (entro un certo margine di errore). -

In Intelligenza Artificiale, inferire significa usare un modello per generare una risposta o una classificazione a partire da un input.

Esempio: Un modello di visione artificiale riceve una foto di un animale a strisce bianche e nere → Inferenza: è una zebra.

In breve: inferire = usare un modello per ottenere un risultato.

Inferenza nel mondo reale: perché incide sui costi

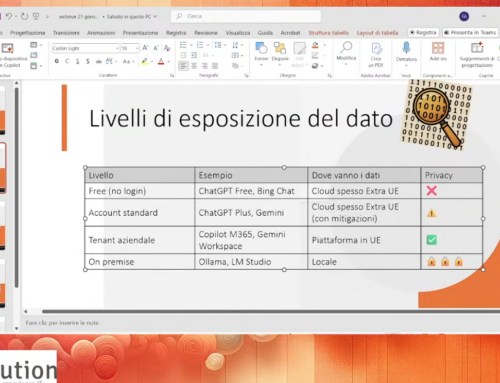

Quando usiamo strumenti come ChatGPT o altri modelli generativi, spesso ci troviamo in un contesto B2C, con un abbonamento mensile “flat” che copre l’uso del servizio tramite interfaccia. Ma le cose cambiano quando passiamo al mondo B2B e vogliamo:

-

Integrare chatbot personalizzati per il customer care

-

Automatizzare processi interni con agenti intelligenti

-

Usare OCR avanzato

-

Generare contenuti visivi o testuali in bulk

In questi casi non interagiamo più direttamente con l’interfaccia del fornitore. Utilizziamo API – interfacce di programmazione che consentono ai nostri software di dialogare con i modelli. E ogni chiamata API ha un costo.

Cos’è un’API e perché è centrale nel consumo di inferenza

Per collegare i nostri sistemi a un modello di IA, generiamo una API Key, cioè una “chiave” di accesso (simile a una password lunga e complessa). Con questa chiave:

-

I nostri sistemi inviano dati al modello

-

Il modello esegue l’inferenza

-

Otteniamo una risposta o un output da usare

Ogni chiamata al modello consuma risorse → e quindi ha un costo.

I rischi nascosti: costi, sicurezza e lock-in

Integrare IA personalizzata è potente, ma bisogna essere consapevoli di alcuni rischi:

-

Crescita incontrollata dei costi se non si monitora l’utilizzo

-

Esposizione delle chiavi API con possibili danni economici o di reputazione

-

Picchi di traffico che fanno lievitare le spese

-

Modelli di pricing poco chiari

-

Dipendenza da un solo fornitore (vendor lock-in)

🛡️ La soluzione? Partire con progetti pilota e valutare sempre il ritorno sull’investimento (ROI).

5 consigli per un uso sostenibile dell’inferenza

-

Scegli il modello giusto

Non serve usare un modello potentissimo per un compito semplice: è inefficiente (e costoso). -

Sfrutta i piani gratuiti

Molti provider offrono “free tier” o crediti iniziali: ideali per test e prototipi. -

Cerca fornitori alternativi

Oltre ai grandi nomi, esistono servizi meno noti che offrono qualità a prezzi più bassi, magari con modelli specializzati. -

Monitora l’uso nel tempo

Log chiari ti aiutano a capire dove ottimizzare per non sprecare risorse. -

Valuta i rischi in anticipo

Una buona analisi preliminare previene brutte sorprese.

Conclusione: l’inferenza è il cuore pulsante delle applicazioni IA

Capire cosa significa “fare inferenza” è il primo passo per usare l’Intelligenza Artificiale in modo consapevole, strategico e sostenibile. Se vuoi esplorare come integrare questi strumenti nel tuo business, siamo qui per aiutarti.